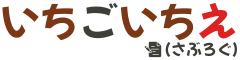

(上記の画像は、とある問題により炎上したブログのスクリーンショットであり、現在は見ることができなくなっております)

裏を取らずにそのまま公開したことによる炎上劇

最近、「図書館の自習室ブログ」(削除済)に公開された記事が問題となり、関係者が直接動き出す事態となりました。その記事で書かれていたのは、著名人があたかも特定の政党を支持する旨の発言をしている、という内容のものでした。

実際に言ったわけでもないのに、あたかも言っているかのように書かれてしまったので、当事者としては寝耳に水という他はありません。否定の声明を出すのも無理はありません。逆に言えば、ブログの管理者がきちんと裏を取っていれば、このような炎上は決して起こらなかったと言えるでしょう。

言うまでもなく、発言の捏造はあってはならないことです。特に政治や宗教のようなセンシティブな話題であれば、尚更やってはいけません。

だからこそ、普通の書き手であれば、情報源を明示するものです。きちんと情報の出所を提示しようとする限り、自身の出す情報に事実性や説得力が出てきますし、自身の出している他の記事・コンテンツの信頼性も上がってくるものです。私自身もできる限りそうなるように努力しています。

裏取りを習慣化しないと痛い目に遭う

- 図書館の自習室ブログ | 全国の図書館の自習室をまとめています(WebArchive)

- れいわ新選組支持者の有名人まとめ!分かりやすく解説 | 図書館の自習室ブログ(2023年11月10日時点のWebArchive) ※記事はまともに見ることができません

- れいわ新選組支持者の有名人まとめ!分かりやすく解説 | 図書館の自習室ブログ(2023年5月27日時点のWebArchive) ※記事の中身をご覧になりたい方向け

- https://twitter.com/k7l0izwDPl1loDg/status/1723166569529033073 (信憑性の疑われる他記事について)

上記ページをご覧いただければお分かりの通り、今回の問題のブログにおいては、そもそも問題となったもの以外にも低品質な記事を多数量産しており、信憑性の疑われるものも含まれておりました。情報の裏取りという基本中の基本が全然できていなかったと言えるでしょう。

そのため、たとえ今回の「れいわ新選組」に関わる捏造が明るみにならなかったとしても、別の部分で問題を起こして炎上する可能性は十分にあったと言えます。

いくら便利なツールであっても過信しない

記事を作成したという人物が、日本テレビの取材に対し、文書で回答しました。

そこでは、「この記事はAIを使って書いた記事であり、内容が合っているかをきちんとチェックしていませんでした。こんな事態になっていることを知らずに、本当にご迷惑かけて申し訳ありません。巻き込んでしまった芸能人の方や、れいわ新選組の関係者の方に申し訳なく思っています。今後は反省してブログを運営していこうと思っています」

と、コメントしています。

蒼井優さんらの“偽コメント”ブログ 作成者が日テレの取材に回答|日テレNEWS NNN

こちらのコメントを見る限りにおいては、生成ツールに頼り切りになってしまったばかりに、ブログの記事がきちんとチェックできていなかった旨のことをおっしゃっています。かと言って、一旦世に広めた自分の発言をなかったことにすることはできません。

そもそも、インターネット上にすでに広まってしまっている情報を一切合切取り消すのは非常に難しいことです。だからこそ自分の公開するものについては気をつけていないといけないのです。

そして、たとえツールであっても中途半端な出力結果に終わることは多々あります。DeepLが正確無比な翻訳をこなせるわけではありませんし、「Google Photo」の消しゴムマジックも望んだ通りになるとは限りません。そのあたりのことからも類推できる通り、文章生成ツールも正しい文章が出てくるとは限らないのです。

そういったことに気を払っていれば、愛用のツールの濫用がたたって自身にとって取り返しのつかない結果を招く、というようなことはなかったわけです。AIだってツールだって完璧ではありませんし、時によっては深い傷跡を残すことにもなるのですね。

過去の類例

チェックミスがもとで大事件に発展した例

きちんとチェックができていなかったばかりに大事になってしまった有名な例としては以下が挙げられるでしょうか。

- ジェイコム株大量誤発注事件 – Wikipedia(2005年12月8日発生)

- 「吉田調書報道取り消し」で朝日は傷だらけ 他にも求められる特ダネの検証 | メディア業界 | 東洋経済オンライン(2014年5月20日発生、同年9月に取消)

- セブンペイの不正アクセスはなぜ起きたのか 「設計、現状認識、後日対応」すべてが甘かった | 災害・事件・裁判 | 東洋経済オンライン(2019年7月発生)

もちろん、生成ツールであっても人間であってもミスはするものです。それだけに、情報や結果などの確認はきちんとしておかないといけません。

今回のブログの炎上についてもそうですが、目先の誘惑に駆られて成果を急いでしまったばかりに、信頼性に大きくヒビが入ってしまう事例は後を絶ちません。くれぐれも最低限のことは行うようにしておきたいものです。

AIの悪用事例

悲しいことですが、こちらについても事例はいくらでも見つかるようになってきております。特に解説はせず、紹介するにとどめておきます。

- 差別主義者と化したAIボット「Tay」からマイクロソフトが学んだこと – CNET Japan (2019年07月29日付の記事)

- 安倍・菅氏の生成AI偽動画も…「岸田首相偽動画」制作者から作り方学んだ男性が作成し投稿 : 読売新聞 (2023年11月11日付の記事)

- 【独自】生成AIで児童の性的画像、国内サイトに大量投稿…推計で毎月3000点以上 : 読売新聞 (2023年11月12日付の記事)

【余談】Googleアドセンスも使う人次第

今回炎上したブログについて、X(旧Twitter)などでも指摘のあった通り、広告を多数表示させることがそもそもの目的だったと思われます。ブログの記事の品質は二の次で、「下手な鉄砲も数打ちゃ当たる」といったところでしょう。そして、今回の炎上したブログでは数多くのGoogleアドセンス広告が貼られておりました。

Googleアドセンスやその他アフィリエイト広告については、残念ながら不正利用者が後を絶ちません。楽して稼ごうといった認識でしか利用していない方が一定数います(今回のブログもその1つと言えるでしょう)。その結果、低品質な記事が量産されることとなり、多くの方から忌み嫌われております。

不正利用者が後を絶たないからということでツールそのものに冷たい視線が送られるのはよくあることではありますが、利用当事者からすれば、見ていて気分の良いものではありません。もちろんGoogleアドセンスにも通報窓口がありますので、今回に限らず、信憑性の薄い情報ばかり出しているサイトやブログはどんどん通報していただきたいと思っております。

アドセンスもAIも文章も、使う人次第で善にも悪にもなります。よく引き合いに出される包丁や車などと同じで、便利な反面、一歩間違えると凶器と化す可能性を秘めています。だからこそ、節度ある利用が大切となってくるのですね。

アドセンスについては不正利用者が数多いために、最近は審査がかなり厳しくなっているとのことです。

また、最近は検索エンジン自体も進化しており、低品質サイトを自動的に排除する仕組みとなっております。そのため、件のブログについてもなかなか見つからず、「発火」までに時間を要したものと思われます。